Ces derniers jours, le travail de l’équipe de recherche de l’Institut international d’innovation de l’Université Beihang, intitulé « SIGMA: Refining Large Language Model Reasoning via Sibling-Guided Monte Carlo Augmentation », a fait l’objet d’une publication à la prestigieuse conférence internationale NeurIPS sur l’intelligence artificielle, illustrant la capacité d’innovation des jeunes chercheurs de Beihang dans la recherche fondamentale en intelligence artificielle. REN Yanwei, doctorant de la promotion 2024 de l’École d’intelligence artificielle de Beihang, en est le premier auteur, et la Professeure LIU Liu au Centre d’innovation en intelligence artificielle de l’Institut international d’innovation de l’Université Beihang, en est l’auteure correspondante. Menée en partenariat entre l’École d’IA de Beihang et l’Institut international d’innovation de Beihang, cette étude a bénéficié d’une coopération étroite avec des institutions de recherche chinoises et internationales, dont l’Université de technologie de Nanyang, l’Université de Leicester et l’Institut des sciences et technologies avancées de Shenzhen de l’Académie chinoise des sciences, montrant ainsi la dynamique de coopération et l’impact mondial de Beihang dans l’innovation en intelligence artificielle.

Dans la phase actuelle du développement des grands modèles de langage (LLMs), le simple fait d’augmenter l’échelle des données entrantes ne permet plus d’obtenir des améliorations significatives de performances. L’optimisation des capacités de raisonnement des modèles est ainsi devenue le nouvel axe de recherche. Le cadre SIGMA (Sibling-Guided Monte Carlo Augmentation) proposé par REN Yanwei et ses collaborateurs réintroduit de manière innovante les « nœuds frères » qui étaient auparavant écartés dans la recherche arborescente de Monte-Carlo (MCTS) et fournit aux modèles un « signal de rétroaction » au niveau sémantique en analysant comparativement les forces et faiblesses des différentes voies de raisonnement. Cette approche confère aux modèles la capacité de réviser et d’améliorer leurs propres processus de raisonnement par comparaison des voies différentes, comme le ferait un humain, augmentant significativement la cohérence logique et la robustesse du raisonnement.

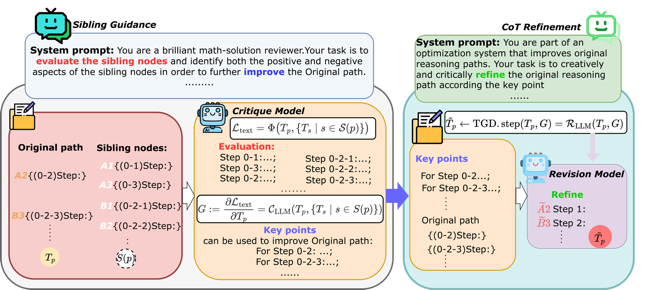

Figure : Résultats des expériences et schéma du processus

Contrairement aux méthodes précédentes qui ne conservaient que le résultat d’une seule voie, le cadre SIGMA utilise une nouvelle technique nommée « Textual Gradient Descent » pour exprimer le processus de réflexion du modèle en langage naturel, rendant l’amélioration du raisonnement dépendante de la compréhension linguistique et du retour sémantique plutôt que des gradients numériques. De cette manière, la précision du raisonnement et l’efficacité dans l’exploitation des données seront considérablement accrues, sans nécessiter d’augmentation de la charge de calcul. Les résultats expérimentaux démontrent que le cadre SIGMA atteint un taux de précision de 54,92 % sur des bancs d’essai de raisonnement mathématique de haute difficulté tels que MATH, en n’utilisant que 30 000 échantillons d’entraînement, surpassant ainsi les modèles entraînés avec près de 600 000 échantillons. Ce travail indique que l’exploitation structurée de données de haute qualité permet d’obtenir des gains de performance dans le raisonnement des grands modèles grâce au principe de « la qualité prime sur la quantité ». Dans de multiples tests, le cadre SIGMA a enregistré des résultats de premier plan sur plusieurs modèles influents, tels que DeepSeekMath-7B, LLaMA3-8B et Mistral-7B, prouvant ainsi sa compatibilité générale et sa capacité d’adaptation intermodèle.

Le lancement du cadre SIGMA marque une autre réussite de l’équipe de recherche en IA de Beihang qui sait combiner parfaitement théorie fondamentale et innovation en ingénierie. Cette avancée met également en lumière l’engagement continu de l’Université Beihang et sa capacité à concrétiser les acquis dans la formation des jeunes chercheurs d’envergure internationale. À l’avenir, l’équipe poursuivra des recherches approfondies sur l’explicabilité, l’optimisation du raisonnement et les mécanismes d’apprentissage auto-supervisé des grands modèles de langage, visant à faire évoluer l’intelligence artificielle du « plus grand » vers le « plus intelligent », et de la simple capacité à « répondre » vers celle à « raisonner ».

Révision : DONG Zhuoning, ZHANG Wei, XIA Wen

Édition : YUAN Xiaohui